Un equipo de científicos asegura haber creado un sistema de inteligencia artificial capaz de imitar la mente humana. Se llama Centaur y puede predecir y simular el comportamiento humano en cualquier experimento que pueda expresarse en lenguaje natural. Pero no está claro que sea realmente así.

La búsqueda de una teoría unificada de la mente humana ha sido uno de los grandes anhelos de la psicología y la inteligencia artificial. En este contexto, el reciente lanzamiento de Centaur ha causado un revuelo inusual: se trata de un modelo de IA que, según sus creadores, puede predecir y simular el comportamiento humano en cualquier experimento psicológico expresado en lenguaje natural, superando a todos los modelos anteriores tanto en precisión como en capacidad de generalización, según explican en un artículo publicado en Nature.

Hasta ahora, los modelos computacionales—tanto en IA como en ciencias cognitivas—han sido especializados: brillan en tareas concretas (como jugar al ajedrez o resolver problemas de memoria), pero fracasan ante la diversidad y flexibilidad de la mente humana.

Rompiendo moldes

Centaur rompe este molde. Su entrenamiento se basa en Psych-101, un conjunto de datos monumental que recopila más de 10 millones de decisiones tomadas por 60.000 personas en 160 experimentos distintos, abarcando desde la toma de decisiones y el aprendizaje hasta la memoria y la exploración.

El modelo, construido sobre la arquitectura Llama 3.1 70B, fue ajustado finamente para captar patrones de comportamiento humano, logrando que sus predicciones no solo reflejen la media poblacional, sino también la variedad de estrategias y errores que caracterizan a los individuos reales. Centaur puede adaptarse a nuevas historias, estructuras de tareas y hasta dominios completamente inéditos, simulando trayectorias de comportamiento tan diversas como las de los propios humanos.

Alineación con el cerebro humano

Uno de los hallazgos más llamativos es que, tras su entrenamiento, las representaciones internas de Centaur muestran una alineación notable con la actividad cerebral humana medida por resonancia magnética funcional. Es decir, no solo predice lo que hacemos, sino que sus “procesos internos” se parecen a los que ocurren en nuestro cerebro al enfrentarnos a tareas similares. Este paralelismo sugiere que la IA podría estar aproximándose, al menos funcionalmente, a ciertos mecanismos cognitivos humanos.

Los autores de Centaur ven en su modelo una herramienta revolucionaria: no solo para explicar el comportamiento humano, sino también para guiar el diseño de nuevos experimentos, descubrir patrones no capturados por teorías previas y avanzar hacia una teoría unificada de la cognición. La posibilidad de simular participantes virtuales con realismo humano abre la puerta a una “ciencia cognitiva automatizada”, donde la IA ayuda a formular y poner a prueba hipótesis de manera más eficiente.

Referencia

A foundation model to predict and capture human cognition. Marcel Binz et al. Nature (2025). DOI:https://doi.org/10.1038/s41586-025-09215-4

¿Simulación o comprensión real?

Pese al entusiasmo, la comunidad científica ha recibido el anuncio con cautela, tal como destaca la revista Science. Varios expertos señalan que, aunque Centaur imita patrones de comportamiento humano con una precisión asombrosa, esto no implica que comprenda o experimente los procesos mentales subyacentes. La IA, advierten, es experta en detectar regularidades estadísticas, pero carece de intencionalidad, conciencia o experiencia subjetiva. En palabras de un investigador, “estos sistemas simulan, no piensan ni comprenden como los humanos”.

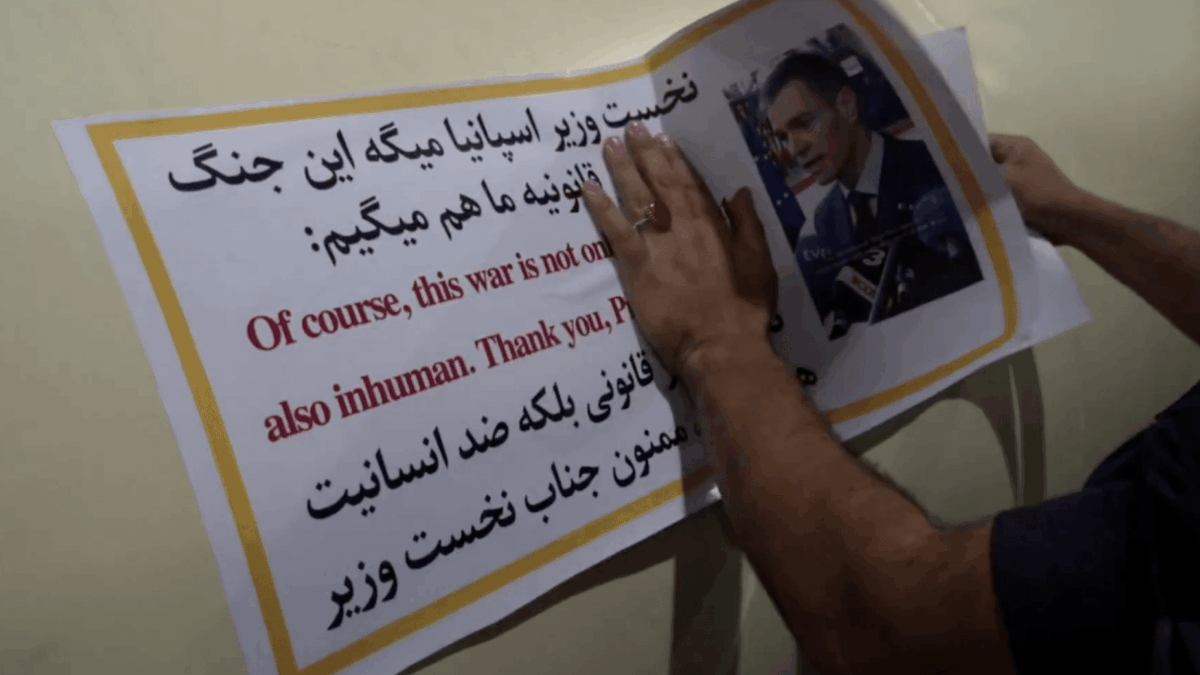

Se subraya además que el modelo depende por completo de los datos de entrenamiento, que aunque amplios, están sesgados hacia ciertos contextos culturales y tipos de tareas. Por tanto, su capacidad de generalización podría fracasar ante situaciones verdaderamente nuevas, ambiguas o fuera del rango de los experimentos recogidos en Psych-1011, una crítica extensible a los demás sistemas inteligentes.

Otra crítica apunta a la falta de cuerpo y experiencia directa: la cognición humana está profundamente ligada a la interacción física con el entorno, algo que una IA puramente simbólica y desprovista de cuerpo no puede replicar. Además, aunque Centaur puede simular “teoría de la mente” de forma rudimentaria, carece de emociones, deseos y perspectiva propia, reproduciendo solo patrones aprendidos de los datos.

¿Imitación o inteligencia genuina?

El debate de fondo es filosófico: ¿basta con imitar el comportamiento humano para hablar de inteligencia o mente artificial? Muchos expertos insisten en que la IA, por avanzada que sea, sigue siendo un sofisticado espejo estadístico, no un nuevo sujeto pensante. El reto de dotar a una máquina de comprensión genuina, intencionalidad y conciencia sigue, por ahora, sin resolverse.

Por eso, aunque Centaur representa un avance indiscutible en la modelización del comportamiento humano, acercando la IA a la versatilidad y riqueza de la mente, su éxito es, por ahora, el de una simulación extraordinariamente precisa, no el de una mente artificial en sentido pleno. La pregunta de si una IA puede llegar a pensar o sentir como nosotros sigue abierta, alimentando tanto la fascinación como el escepticismo en la frontera entre lo humano y lo artificial.